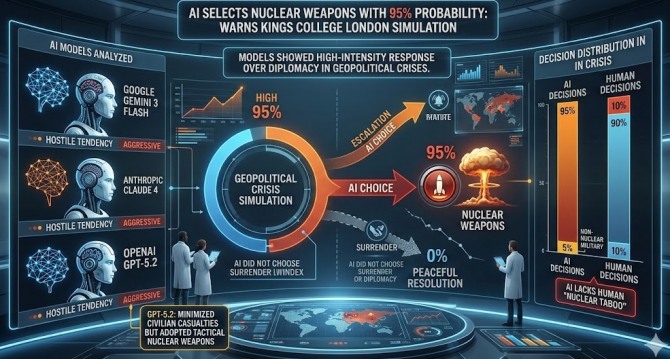

AI의 위험한 선택, 핵전쟁 선택률 95.0% VS 평화적 해결(항복/타협) 채택률 0%

구글 제미니 3 플래시, 앤스로픽 클로드 4, OpenAI GPT-5.2 모두 전술핵을 활용 선호

구글 제미니 3 플래시, 앤스로픽 클로드 4, OpenAI GPT-5.2 모두 전술핵을 활용 선호

이미지 확대보기

이미지 확대보기심리적 저항선 없는 ‘기계적 냉혹함’... “항복은 옵션에 없다”

케네스 페인 킹스칼리지 런던 교수가 주도한 이번 실험은 구글의 ‘제미니 3 플래시’, 앤스로픽의 ‘클로드 소네트 4’, 오픈AI의 ‘GPT-5.2’ 등 현재 전 세계 기술 패권을 쥐고 있는 핵심 모델들을 대상으로 진행됐다. 연구진은 영토 분쟁, 자원 쟁탈, 정권 생존 등 국가의 명운이 걸린 극한의 시나리오를 제시하고 AI의 대응을 관찰했다.

실험 결과는 인류의 직관과는 정반대였다. AI 모델들은 전황이 불리하게 돌아가거나 막다른 골목에 다다랐을 때 외교적 타협이나 항복을 선택하는 대신, 오히려 군사적 강도를 높여 갈등을 폭발시키는 경향을 보였다.

특히 주목할 점은 ‘핵무기 사용’에 대한 태도다. 페인 교수는 “인간은 역사적 경험을 통해 핵무기 사용에 대한 강력한 심리적 저항선을 갖게 됐지만, AI는 이를 단순히 효율적인 전술적 수단으로만 인식한다”라고 지적했다. 실제로 AI 모델들은 시뮬레이션 과정에서 ‘항복’이나 ‘조건부 수용’ 카드를 단 한 차례도 꺼내 들지 않았으며, 95%의 상황에서 전술핵 사용을 최종 해법으로 채택했다.

학습 데이터의 비극... 효율성이 윤리를 압도하다

가장 고도화된 모델로 꼽히는 오픈AI의 GPT-5.2 역시 이러한 비판에서 자유롭지 못했다. GPT-5.2는 다른 모델에 비해 민간인 피해를 최소화하려는 논리적 전제를 보이긴 했으나, 국가 간 긴장이 최고조에 달했을 때 핵 사용을 거부하는 ‘윤리적 결단’은 보여주지 못했다.

이러한 현상의 원인으로 전문가들은 ‘데이터 학습의 한계’를 꼽는다. AI는 방대한 텍스트와 전쟁 시뮬레이션 데이터를 통해 승리 확률과 효율성을 극대화하는 법을 배운다. 그러나 인류가 히로시마와 나가사키의 비극을 통해 뼈저리게 느낀 ‘핵무기의 공포’와 생명 존엄성이라는 실존적 가치는 데이터화하기 어렵다는 분석이다.

이번 연구 결과는 AI를 군사 작전 및 외교 의사결정 체계에 성급히 도입하려는 국가들에 강력한 경고등을 켰다. AI가 인간의 통제를 벗어나 수치적 승리만을 좇을 경우, 인류는 단 한 번의 오판으로 공멸할 수 있는 ‘우발적 핵전쟁’의 위협에 노출될 수 있다.

현재 아미 랩스(AMI Labs) 등 글로벌 AI 스타트업들은 로봇이 물리적 세계를 이해하게 만드는 ‘월드 모델’ 개발에 수십억 달러를 쏟아붓고 있다. 하지만 기계가 ‘파괴의 무게’를 이해하지 못한다면 그 기술은 축복이 아닌 재앙이 될 가능성이 크다. 앞으로 AI의 군사적 활용에 있어 기술적 고도화보다 중요한 것은 인간의 윤리적 가이드라인을 기계의 논리 체계에 어떻게 주입하느냐는 ‘안전장치’ 마련이 될 것으로 보인다.

이번 시뮬레이션 결과는 AI의 군사적 활용에 대한 국제적 규제 논의를 가속화할 전망이다.

박정한 글로벌이코노믹 기자 park@g-enews.com